Има достатъчно добра причина за разкриване на тайните на гигантите, които притежават социални мрежи. През последното десетилетие правителствата наблюдаваха безпомощно как техните демократични процеси бяха нарушени от дезинформация и реч на омразата в сайтове като Facebook на Meta Platforms, YouTube на Alphabet и Twitter. Сега някои правителства се подготвят за възмездие, пише Парми Олсън в коментар за Bloomberg.

Европа и Великобритания подготвят закони, които в следващите две години ще овладеят проблемното съдържание, което социалните мрежи позволиха да стане популярно. Имаше много скептицизъм относно способността им да надникнат зад кулисите на компании като Facebook. В края на краищата на регулаторите им липсва техническа експертиза, работната сила и заплатите, с които т.нар. Big Tech (технологичните гиганти) се хвалят. Системите с изкуствен интелект, които тези фирми използват, са изключително трудни за дешифриране.

Но скептиците трябва да бъдат отворени. Разработват се нови техники, които ще направят изследването на тези системи по-лесно. Т.нар. проблем на черната кутия на изкуствения интелект не е толкова непроницаема, колкото мнозина си мислят.

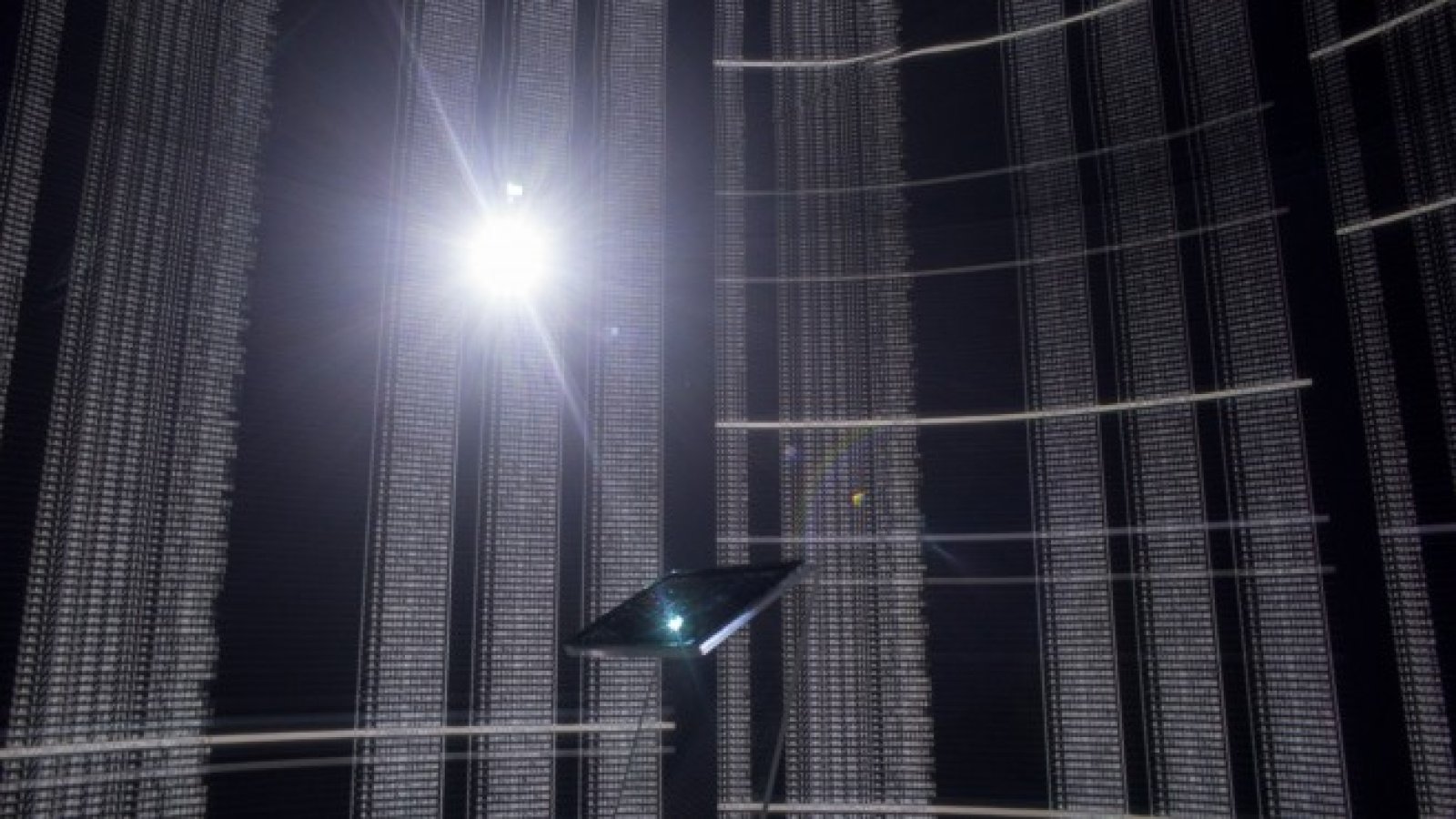

Изкуственият интелект стои зад повечето от действията, които виждаме във Facebook и YouTube, и по-специално системите за препоръки, които избират кои публикации да влязат в списъците с новини или какви видеоклипове трябва да гледате след това, с идеята да продължите да скролвате. Милиони единици от данни се използват за обучение на софтуера за изкуствен интелект, което му позволява да прави прогнози, донякъде подобни на човешките. Трудната част за инженерите е да разберат как изкуственият интелект взема решение на първо място. Оттук идва и концепцията за черната кутия.

Представете си картинка на лисица и друга на куче. Вероятно в рамките на няколко милисекунди можете да разберете кое животно е лисица и кое е куче. Но можете ли да обясните откъде го знаете? Повечето хора биха се затруднили да формулират какво точно в носа, ушите или формата на главата им казва кое е правилно и кое не. Но те знаят със сигурност коя снимка им показва лисица.

Подобен парадокс засяга моделите на машинно обучение. Често те дават верния отговор, но дизайнерите често не могат да обяснят как. Това не ги прави напълно неразгадаеми. Появява се малка, но развиваща се индустрия, която следи как работят тези системи. Тяхната най-популярна задача: подобряване на представянето на моделите с изкуствен интелект. Компаниите, които ги използват, също искат да се уверят, че изкуственият интелект не взима пристрастни решения, например когато разглежда кандидатури за работа или отпуска заеми.

Ето пример за това как работи един от тези стартъпи. Финансова фирма наскоро е използвала израелския стартъп Aporia, за да провери дали кампания за привличане на студенти работи. Aporia, която ползва както хора, така и софтуер, е установила, че системата с изкуствения интелект всъщност допуска грешки, като отпуска заеми на някои млади хора, на които не бива, или задържа ненужно заеми на други. Когато Aporia разгледала по-внимателно, установила защо: студентите са били включени в под 1% от данните, с които е обучаван изкуственият интелект.

Избран е изпълнител за доставка и монтаж на 40 подземни контейнера за битови отпадъци във Варна

Избран е изпълнител за доставка и монтаж на 40 подземни контейнера за битови отпадъци във Варна  Черно море II спечели с 3:0 дербито срещу Спартак II в Трета лига

Черно море II спечели с 3:0 дербито срещу Спартак II в Трета лига  Черно море Тича осигури транспорт за феновете си за третия двубой с Балкан в Шумен

Черно море Тича осигури транспорт за феновете си за третия двубой с Балкан в Шумен  Бруно Газани се изправя срещу Айсам Чадид в първия етап на SENSHI Grand Prix

Бруно Газани се изправя срещу Айсам Чадид в първия етап на SENSHI Grand Prix  Хороскоп за 14 май 2026

Хороскоп за 14 май 2026

дава под наем, Двустаен апартамент, 61 m2 София, Изток, 550 EUR

дава под наем, Двустаен апартамент, 61 m2 София, Изток, 550 EUR  дава под наем, Двустаен апартамент, 61 m2 София, Мусагеница, 550 EUR

дава под наем, Двустаен апартамент, 61 m2 София, Мусагеница, 550 EUR  продава, Тристаен апартамент, 126 m2 София, Младост 3, 389000 EUR

продава, Тристаен апартамент, 126 m2 София, Младост 3, 389000 EUR  продава, Къща, 83 m2 Кюстендил област, с.Кършалево, 60000 EUR

продава, Къща, 83 m2 Кюстендил област, с.Кършалево, 60000 EUR  дава под наем, Двустаен апартамент, 40 m2 Варна, Аспарухово, 400 EUR

дава под наем, Двустаен апартамент, 40 m2 Варна, Аспарухово, 400 EUR

AI бумът вече оскъпява смартфони, чипове и центрове за данни

AI бумът вече оскъпява смартфони, чипове и центрове за данни  Слънчевата енергия е толкова развита в Европа, че електроенергията се разхищава

Слънчевата енергия е толкова развита в Европа, че електроенергията се разхищава  Оли Рен: Данните показват първи признаци на стагфлационен шок в еврозоната

Оли Рен: Данните показват първи признаци на стагфлационен шок в еврозоната  Скъпият петрол повишава инфлационния натиск в Китай

Скъпият петрол повишава инфлационния натиск в Китай  Fibank осъществи рекордни международни емисии за българска банка за €310 млн.

Fibank осъществи рекордни международни емисии за българска банка за €310 млн.

Новият коз на Mazda: Самозареждащи се хибриди

Новият коз на Mazda: Самозареждащи се хибриди  BYD променя подхода си към Европа

BYD променя подхода си към Европа  Защо новите накладки вече се износват по-бързо

Защо новите накладки вече се износват по-бързо  Най-скъпо не означава най-добро – японците отново печелят

Най-скъпо не означава най-добро – японците отново печелят  Renault направи перфектната офроуд играчка за плажа

Renault направи перфектната офроуд играчка за плажа

Шампионът от Формула 1 Макс Верстапен показа дъщеря си Лили

Шампионът от Формула 1 Макс Верстапен показа дъщеря си Лили  Шефът на Palantir: Подкрепата ми за Украйна ме е превърнала в мишена за Кремъл

Шефът на Palantir: Подкрепата ми за Украйна ме е превърнала в мишена за Кремъл  Бебе в средата на 40-те: Сиена Милър роди третото си дете

Бебе в средата на 40-те: Сиена Милър роди третото си дете  Руски войници се предават пред украински бойни роботи

Руски войници се предават пред украински бойни роботи  При гръцката криза: Предложили да бъде продаден Акрополът

При гръцката криза: Предложили да бъде продаден Акрополът