Практиките за безопасност на големите компании за изкуствен интелект като Anthropic, OpenAI, xAI и Meta са „далеч от нововъзникващите глобални стандарти“, сочи новото издание на индекса за безопасност на изкуствения интелект на Future of Life Institute, публикуван в сряда и цитиран от Ройтерс.

Институтът съобщи, че оценката на безопасността, направена от независим експертен панел, е установила, че докато компаниите са заети с надпреварата за разработване на суперинтелигентност, никоя от тях не разполага с надеждна стратегия за контрол на такива усъвършенствани системи.

Проучването е публикувано на фона на засилените обществени опасения относно социалното въздействие на системи, по-умни от човека, които са способни на разсъждаване и логическо мислене, след няколко случая на самоубийство и самонаранявания, които бяха свързани с чатботове с изкуствен интелект.

„Въпреки неотдавнашния шум около хакерските атаки, подхранвани от изкуствен интелект, и AI, който подтиква хората към психози и самонараняване, американските компании за изкуствен интелект остават по-слабо регулирани от ресторантите и продължават да лобират срещу задължителните стандарти за безопасност“, казва Макс Тегмарк, преподавател в Масачузетския технологичен институт и президент на Future of Life.

Надпреварата в областта на изкуствения интелект също не показва признаци на забавяне, като големите технологични компании инвестират стотици милиарди долари в модернизиране и разширяване на усилията си в областта на машинното обучение.

Future of Life Institute е неправителствена организация, която изразява притеснение относно рисковете, които интелигентните машини представляват за човечеството. Основана през 2014 г., тя беше подкрепена в началото от главния изпълнителен директор на Tesla Илон Мъск.

През октомври група, включваща учените Джефри Хинтън и Йошуа Бенгио, призова за забрана на разработването на свръхинтелигентен изкуствен интелект, докато обществото не го поиска и науката не проправи безопасен път напред.

XAI заяви, че „традиционните медии лъжат“ в нещо, което изглеждаше като автоматичен отговор, а Anthropic, OpenAI, Google DeepMind, Meta, Z.ai, DeepSeek и Alibaba Cloud не са отговорили веднага на искането за коментар относно проучването.

Ето къде няма да има ток днес във Варна

Ето къде няма да има ток днес във Варна  Виц на деня - 14 май

Виц на деня - 14 май  Днес времето остава дъждовно

Днес времето остава дъждовно  Тежка катастрофа със загинал край Карлово

Тежка катастрофа със загинал край Карлово  Медицински хеликоптер е транспортирал мъж с черепно-мозъчна травма

Медицински хеликоптер е транспортирал мъж с черепно-мозъчна травма

продава, Къща, 280 m2 София област, с.Бракьовци, 165000 EUR

продава, Къща, 280 m2 София област, с.Бракьовци, 165000 EUR  дава под наем, Тристаен апартамент, 116 m2 София, Витоша, 1000 EUR

дава под наем, Тристаен апартамент, 116 m2 София, Витоша, 1000 EUR  дава под наем, Склад, 650 m2 София, Овча Купел 1, 2588 EUR

дава под наем, Склад, 650 m2 София, Овча Купел 1, 2588 EUR  дава под наем, Двустаен апартамент, 61 m2 София, Изток, 550 EUR

дава под наем, Двустаен апартамент, 61 m2 София, Изток, 550 EUR  дава под наем, Двустаен апартамент, 61 m2 София, Мусагеница, 550 EUR

дава под наем, Двустаен апартамент, 61 m2 София, Мусагеница, 550 EUR

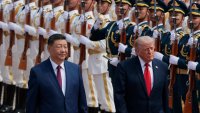

Си Дзинпин изтъкна Тайван като основен въпрос на срещата с Тръмп

Си Дзинпин изтъкна Тайван като основен въпрос на срещата с Тръмп  Българите вече имат значително богатство, но не го използват за повече доходност

Българите вече имат значително богатство, но не го използват за повече доходност  AI бумът вече оскъпява смартфони, чипове и центрове за данни

AI бумът вече оскъпява смартфони, чипове и центрове за данни  IEA: Петролните запази намаляват с рекордно темпо, част 2

IEA: Петролните запази намаляват с рекордно темпо, част 2  IEA: Петролните запази намаляват с рекордно темпо, част 1

IEA: Петролните запази намаляват с рекордно темпо, част 1

Volkswagen отново отложи електрическия Golf

Volkswagen отново отложи електрическия Golf  Новият коз на Mazda: Самозареждащи се хибриди

Новият коз на Mazda: Самозареждащи се хибриди  BYD променя подхода си към Европа

BYD променя подхода си към Европа  Защо новите накладки вече се износват по-бързо

Защо новите накладки вече се износват по-бързо  Най-скъпо не означава най-добро – японците отново печелят

Най-скъпо не означава най-добро – японците отново печелят

Затрупани хора след руска атака срещу Киев

Затрупани хора след руска атака срещу Киев  Интер със златен дубъл - и Купата на Италия към Скудетото

Интер със златен дубъл - и Купата на Италия към Скудетото  Внук на легендата Мърков стана европейски шампион по борба

Внук на легендата Мърков стана европейски шампион по борба  Куба остана напълно без дизел и мазут

Куба остана напълно без дизел и мазут  Си Дзинпин: Китай и САЩ трябва да избегнат пътя към война

Си Дзинпин: Китай и САЩ трябва да избегнат пътя към война